SlowFast-LLaVA-1.5は、なぜ長尺ビデオ理解のブレークスルーとなり得るのか—計算コストをかけずに

AIビデオ処理の本当のボトルネックは?計算量だけでなくトークン数

長尺ビデオコンテンツが急増しています。監視映像から教育講座まで、数分から数時間にも及ぶビデオから洞察を得る必要性がかつてないほど高まっています。しかし、AIにとって、ビデオ内の長距離の時間的文脈を理解することは、単に多くのフレームを投入したり、より大きなモデルを微調整したりするだけでは済みません。

真の課題は?トークン効率です。

既存のビデオ大規模言語モデル(Video LLM)のほとんどは、スケールアップに苦労しています。膨大な量のデータを処理しますが、計算量とメモリを大量に消費するため、モバイル、エッジ、あるいは多くのエンタープライズ環境への展開には実用的ではありません。

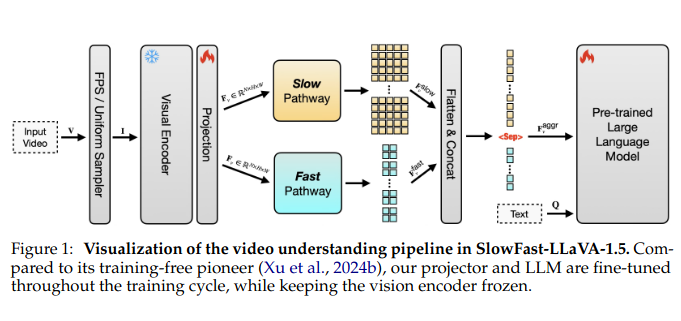

そこで登場するのがSlowFast-LLaVA-1.5です。長尺ビデオ理解のための、トークン効率の良い、再現可能なソリューションとして開発され、斬新な2ストリーム処理アプローチと、無駄のないトレーニングパイプラインを組み合わせることで、より小さなモデル(10億パラメータ程度)でも最先端のパフォーマンスを実現します。

スケーラブルなAIに賭けている企業や、エッジ展開可能なAIソリューションを探している投資家にとって、このモデルは技術的にも戦略的にも重要な転換点となります。

ゲームを変えた2ストリームアーキテクチャ

SlowFast-LLaVA-1.5の中核となるのは、ビデオ認識における先行研究から借用し、適合させた巧妙なアーキテクチャの工夫、SlowFastメカニズムです。その仕組みは次のとおりです。

- Slowストリームは、より少ないフレームをより高い解像度で処理し、選択されたキーフレームから豊富な空間的詳細をキャプチャします。

- Fastストリームは、より多くのフレームを処理しますが、粒度は低く、動きと時間的な流れに焦点を当てます。

これらの経路を組み合わせ、その出力を集約することで、モデルは各フレームで何が起こっているかと、シーンが時間の経過とともにどのように進化するかを、トークンに溺れることなくキャプチャします。

これは、空間精度と時間的リーチのバランスを取るのに苦労するモノリシックなビデオトランスフォーマーからの転換です。その結果、SlowFast-LLaVA-1.5は、他の主要モデルと比較して、わずか65%のトークンでほぼ2倍のフレームを処理します。

無駄のないトレーニング、より幅広い採用

大規模なビデオモデルのトレーニングは、悪名高いほど煩雑です—多くの場合、独自のデータセット、多段階のパイプライン、およびリソースを大量に消費するチューニングが含まれます。SlowFast-LLaVA-1.5の作成者は、より実用的なルートを取りました。

- ステージI – 画像のみの微調整: モデルは、視覚的な基礎付けと一般的な推論を確立するために、最初に公開されている画像データセットでトレーニングされます。

- ステージII – 結合ビデオ-画像トレーニング: 次に、キュレーションされたビデオおよび画像データセットに触れさせ、モデルが空間的および時間的ダイナミクスの両方を学習できるようにします。

データセットはオープンソースであり、アプローチは再現可能です—これは、最近のLLMリリースには欠けていることが多い2つの属性です。このアクセシビリティの重視は、単なる学術的なものではありません。高度なビデオAIを統合しようとしている中小企業やスタートアップにとって、参入障壁を下げます。

主張を裏付けるベンチマーク

パフォーマンス指標は、以下を含む複数の注目度の高いベンチマークでテストされました。

- LongVideoBench: 7Bモデルで62.5%

- MLVU(マルチモーダル長尺ビデオ理解): 同じモデルで71.5%

特に、1Bおよび3Bパラメータモデルでさえ、競争力のある結果を達成し、サイズが常に差別化要因ではないことを証明しました。これは、モバイルまたはエッジベースの展開を検討している企業にとって特に魅力的な特性です。

さらに、共同トレーニング戦略のおかげで、モデルは画像推論能力を犠牲にしませんでした。専用の画像-言語モデルと同等の性能を発揮し、統合されたマルチモーダル処理にとって明らかに有利です。

妥協のない効率

生の数字では、効率の向上が明らかです。

- 最大2倍の数のフレームを処理

- 同等のモデルよりも約35%少ないトークンを使用

- パフォーマンスレベルを維持または上回りながら、計算コストを大幅に削減

精度と効率のこのバランスにより、スマートカメラやIoT監視システムから、アプリ内ビデオアシスタントやエンタープライズナレッジマイニングツールまで、より幅広いユースケースが開かれます。

投資家にとって、それはより強力なROIと製品化への低い障壁を意味します。

セクター全体の戦略的価値

エンタープライズAI統合: コンパクトなサイズと効率的なアーキテクチャにより、SlowFast-LLaVA-1.5は、帯域幅、計算量、およびレイテンシが重要な制約となる環境に展開できます—たとえば、オンサイト監視、小売における顧客行動分析、または現場での機械診断などです。

メディアおよびストリーミングプラットフォーム: 長尺メディアの自動要約、検索インデックス作成、およびコンテンツモデレーションが低コストで実現可能になります。

支援技術とアクセシビリティ: 処理にクラウド規模のインフラストラクチャが必要ない場合、視覚障害者向けのビデオのリアルタイム解釈がより実現可能になります。

セキュリティと防衛: ドローンおよびオンデバイス監視システムは、ギガバイト単位のビデオをアップリンクせずにライブフィードを分析できる小型モデルから大きな恩恵を受けます。

制限と未開拓の機会

作成者は、2つの重要な制限を認めています。

- フレームサンプリングの制限: フレームサンプリングはほとんどのユースケースでFPSベースですが、ビデオの長さが設定されたフレームのしきい値を超えると、モデルは均一サンプリングにデフォルト設定されます—これにより、超長尺コンテンツの重要な瞬間を見逃す可能性があります。

- フリーズされたビジョンエンコーダ: 効率を維持するために、ビジョンエンコーダはトレーニング中にフリーズされたままになります。効果的ですが、このモジュールを微調整すると、より高いパフォーマンスが得られる可能性がありますが、計算コストは高くなります。

これらの制約は、将来のバージョンに向けた論理的な次のステップを示しています。適応型サンプリング技術、選択的なビジョンモジュールのチューニング、およびメモリ効率の高いアーキテクチャの統合です。

これが業界にとって重要な理由

ビジョン-言語パラダイムは急速に進化しています。これまで、ビデオAIにおけるほとんどのブレークスルーは、力ずく—より大きなモデル、より大きなデータセット、より多くのトークンに頼ってきました。

SlowFast-LLaVA-1.5は、戦略的に無駄のないアプローチを提供します。これは単なる新しいモデルではありません—効率的なAIがインフラストラクチャに過負荷をかけることなく、業界全体でビデオ理解をどのようにスケールできるかの青写真です。

トークン効率はパラメータスケールと同じくらい強力になり得ることを示しています—これは研究コミュニティと商業エコシステムの両方が真剣に受け止める必要があるメッセージです。

投資家と開発者向けの最終的な要点

ロードマップにインテリジェントなビデオ処理が含まれている場合—コンシューマーテクノロジー、産業用アプリケーション、またはリアルタイム分析のいずれであっても—SlowFast-LLaVA-1.5は、高性能AIが高コストAIを意味する必要はないというシグナルです。

ベンチャーキャピタルにとって、これは以前は大規模なビデオモデルをトレーニングまたは実行するためのリソースが不足していたスタートアップを支援する扉を開きます。エンタープライズビルダーにとって、これはインフラストラクチャスタック全体を再構築することなく、競争力のあるビデオAIを展開するチャンスです。